В заказе нет товаров

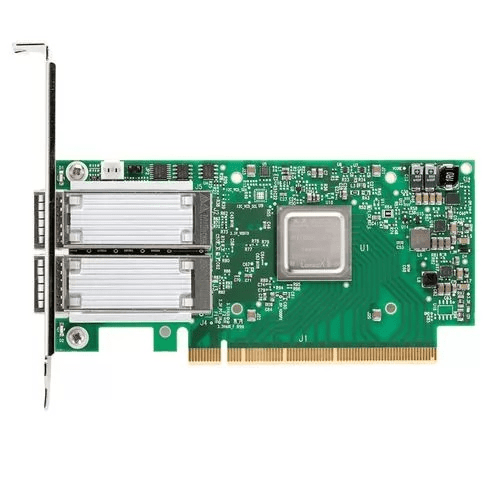

Сетевой адаптер Mellanox ConnectX-5 Dual-Port 100GbE/EDR InfiniBand

| Код производителя | MCX556A-ECAT |

| Интерфейс хоста | PCI Express 3.0 x16 |

| Количество портов | 2 |

| Тип портов | QSFP28 |

| Поддерживаемые технологии | Ethernet 100 Гбит/с, InfiniBand EDR |

| Комплектация | Кронштейн полной высоты (Low-profile не входит) |

Подробные комментарии к характеристикам:

Адаптер поддерживает конвергентный интерфейс VPI (Virtual Protocol Interconnect), что позволяет гибко выбирать между работой в сетях Ethernet или InfiniBand. Скорость 100 Гбит/с (EDR) на порт является стандартом для высокопроизводительных вычислений. Разъем PCIe 3.0 x16 обеспечивает необходимую пропускную способность для двунаправленного трафика двух портов. Кронштейн полной высоты (tall bracket) предназначен для установки в стандартные серверные шасси.

Адаптер поддерживает конвергентный интерфейс VPI (Virtual Protocol Interconnect), что позволяет гибко выбирать между работой в сетях Ethernet или InfiniBand. Скорость 100 Гбит/с (EDR) на порт является стандартом для высокопроизводительных вычислений. Разъем PCIe 3.0 x16 обеспечивает необходимую пропускную способность для двунаправленного трафика двух портов. Кронштейн полной высоты (tall bracket) предназначен для установки в стандартные серверные шасси.

Технологии и преимущества:

- ConnectX-5 ASIC: Поколение процессоров Mellanox, обеспечивающее высокую пропускную способность и крайне низкую задержку обработки данных.

- VPI (Virtual Protocol Interconnect): Позволяет одному адаптеру работать как в сетях Ethernet, так и InfiniBand, повышая гибкость инфраструктуры.

- Аппаратная офлоад-обработка: Передача задач обработки сетевого стека (RoCE, GPUDirect) с ЦПУ на чип адаптера, снижая нагрузку на процессор сервера.

- Поддержка RDMA: Ключевая технология для прямого доступа к памяти, критически важная для кластеров HPC, AI/ML и систем хранения.

Адаптер Mellanox ConnectX-5 решает следующие задачи:

- Организация высокоскоростной магистрали для кластеров высокопроизводительных вычислений (HPC).

- Построение сетей для систем искусственного интеллекта и машинного обучения (AI/ML).

- Создание низколатентных соединений для распределенных систем хранения (SAN, hyper-converged).

- Апгрейд сетевой инфраструктуры дата-центра до стандарта 100 Гбит/с.

- Обеспечение конвергентной сети, способной работать поверх Ethernet или InfiniBand.

В отзывах наши покупатели обычно упоминают:

- Крайне низкая задержка и стабильная пропускная способность при полной загрузке портов.

- Эффективная разгрузка CPU благодаря аппаратному офлоаду, что важно для виртуализации.

- Хорошая совместимость с основными дистрибутивами Linux и современными гипервизорами.

- Надежность работы в круглосуточном режиме в составе кластерных решений.

- Высокая производительность при использовании технологий GPUDirect и RDMA.

Рекомендации покупателям:

- Перед установкой убедитесь в наличии совместимого слота PCIe 3.0/4.0 x8 или x16 на материнской плате сервера и достаточном охлаждении.

- Для работы на 100 Гбит/с необходима соответствующая кабельная инфраструктура: активные оптические кабели (AOC) или DAC-кабели, а также совместимые коммутаторы QSFP28.

- Для раскрытия преимуществ RDMA (включая RoCE) требуется корректная настройка как на стороне адаптера (чесно ONYX или Mellanox firmware tools), так и на коммутаторах.

- Рекомендуется использовать актуальные драйверы и firmware с официального сайта NVIDIA/Mellanox для обеспечения стабильности и безопасности.

- В инфраструктуре InfiniBand данный адаптер требует наличия управляющего ПО Subnet Manager для корректного функционирования сети.

Оформление заказа

Резерв на 2 дня

Готовы купить MCX556A-ECAT Mellanox ConnectX-5 VPI adapter card, EDR IB (100Gb/s) and 100GbE, dual-port QSFP28, PCIe3.0 x16, tall bracket?

- Оформите заказ на сайте или отправьте запрос на счет вместе с реквизитами организации, контактным лицом и адресом доставки.

- Товар будет зарезервирован на 2 дня.

- Счет придет на Вашу электронную почту в течение 30 минут.

- Отгрузка производится в течение 1-2 дней после поступления оплаты. Можно забрать самовывозом или доставкой.

- УПД отправим через ЭДО.